PyTorch如何使用标签平滑 PyTorch中标签平滑使用方法

PyTorch如何使用标签平滑?本篇文章小编给大家分享一下PyTorch中标签平滑使用方法,小编觉得挺不错的,现在分享给大家供大家参考,有需要的小伙伴们可以来看看。

标签平滑

假设这里有一个多分类问题,在这个问题中,目标变量通常是一个one-hot向量,即当处于正确分类时结果为1,否则结果是0。

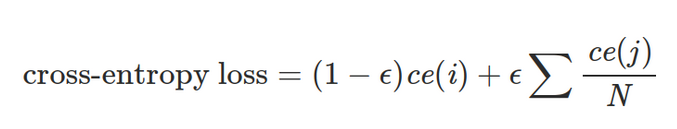

标签平滑改变了目标向量的最小值,使它为ε。因此,当模型进行分类时,其结果不再仅是1或0,而是我们所要求的1-ε和ε,从而带标签平滑的交叉熵损失函数为如下公式。

在这个公式中,ce(x)表示x的标准交叉熵损失函数,例如:-log(p(x)),ε是一个非常小的正数,i表示对应的正确分类,N为所有分类的数量。

直观上看,标记平滑限制了正确类的logit值,并使得它更接近于其他类的logit值。从而在一定程度上,它被当作为一种正则化技术和一种对抗模型过度自信的方法。

PyTorch中的使用

在PyTorch中,带标签平滑的交叉熵损失函数实现起来非常简单。首先,让我们使用一个辅助函数来计算两个值之间的线性组合。

deflinear_combination(x, y, epsilon):return epsilon*x + (1-epsilon)*y

下一步,我们使用PyTorch中一个全新的损失函数:nn.Module.

import torch.nn.functional as F

defreduce_loss(loss, reduction='mean'):return loss.mean() if reduction=='mean'else loss.sum() if reduction=='sum'else loss

classLabelSmoothingCrossEntropy(nn.Module):def__init__(self, epsilon:float=0.1, reduction='mean'):

super().__init__()

self.epsilon = epsilon

self.reduction = reduction

defforward(self, preds, target):

n = preds.size()[-1]

log_preds = F.log_softmax(preds, dim=-1)

loss = reduce_loss(-log_preds.sum(dim=-1), self.reduction)

nll = F.nll_loss(log_preds, target, reduction=self.reduction)

return linear_combination(loss/n, nll, self.epsilon)

我们现在可以在代码中删除这个类。对于这个例子,我们使用标准的fast.ai pets example.

from fastai.vision import *

from fastai.metrics import error_rate

# prepare the data

path = untar_data(URLs.PETS)

path_img = path/'images'

fnames = get_image_files(path_img)

bs = 64

np.random.seed(2)

pat = r'/([^/]+)_\d+.jpg$'

data = ImageDataBunch.from_name_re(path_img, fnames, pat, ds_tfms=get_transforms(), size=224, bs=bs) \

.normalize(imagenet_stats)

# train the model

learn = cnn_learner(data, models.resnet34, metrics=error_rate)

learn.loss_func = LabelSmoothingCrossEntropy()

learn.fit_one_cycle(4)

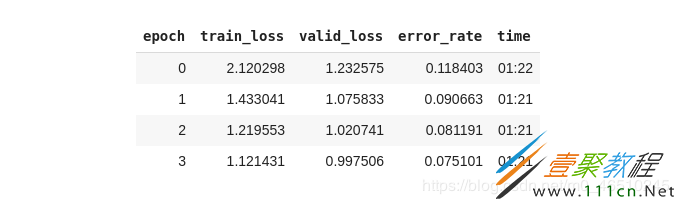

最后将数据转换成模型可以使用的格式,选择ResNet架构并以带标签平滑的交叉熵损失函数作为优化目标。经过四轮循环后,其结果如下

我们所得结果的错误率仅为7.5%,这对于10行左右的代码来说是完全可以接受的,并且在模型中大多数参数还都选择的是默认设置。

因此,在模型中还有许多参数可以进行调整,从而使得模型的表现性能更好,例如:可以使用不同的优化器、超参数、模型架构等。

PHP之友评论